Sehr geehrter Herr Ministerpräsident Armin Laschet,

Sehr geehrte Frau Staatssekretärin Andrea Milz,

ich habe heute eine Mail von meinem Golfclub erhalten, wonach die Anlage „jedenfalls bis Anfang Mai geschlossen“ und weiterhin kein Trainings- und Spielbetrieb möglich ist. Laut Information des Deutschen Golfverbandes DGV soll eine „neuerliche Prüfung“ dieser Restriktionen erst am 30. April erfolgen – wenn ich das „jedenfalls bis Anfang Mai“ richtig interpretiere, ist ja offenbar eine weitere Verlängerung der angeordneten Schließung durchaus möglich.

Der DGV als Dachverband hat sich zu dem von der Regierung getroffenen Beschluss bzw. den Ausführungsbestimmungen bereits „mit Enttäuschung und Unverständnis“ geäußert. Ich möchte Sie – lieber Herr Laschet und liebe Frau Milz – heute als Bürger des Landes Nordrhein-Westfalen; als Privatmensch, aber auch als Journalist fragen:

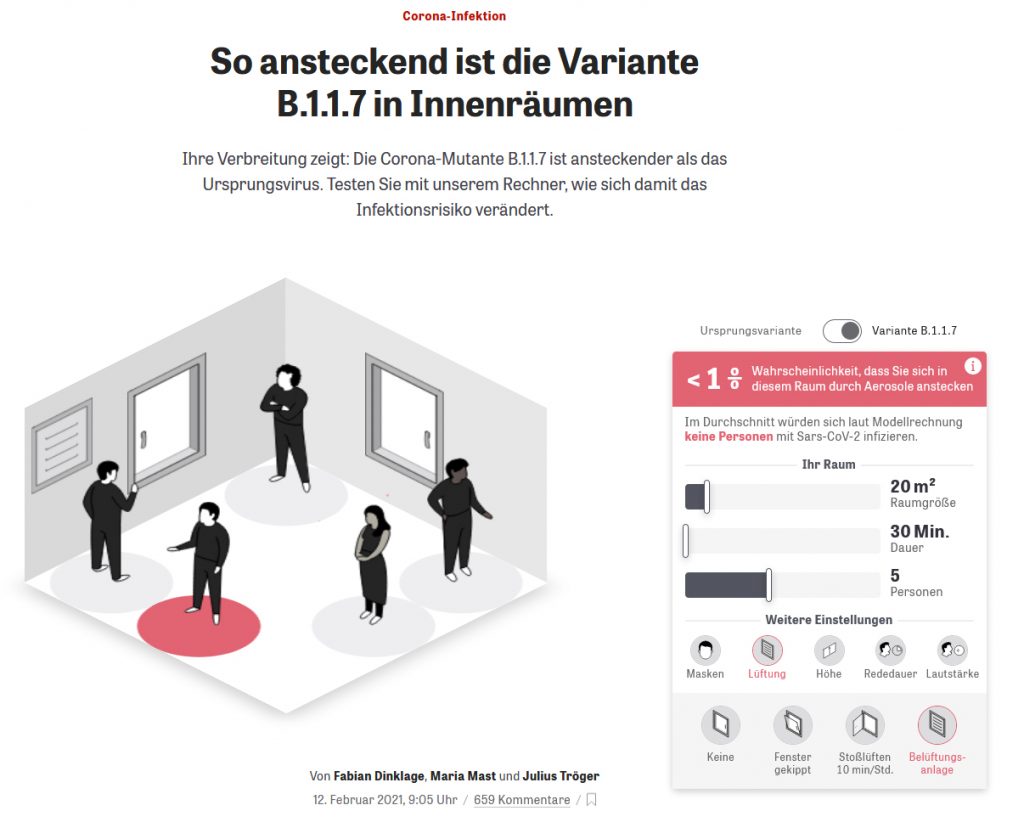

Können Sie mir irgendwelche Sachargumente nennen, inwiefern das Golfspielen für mich selbst oder für andere ein erhöhtes oder überhaupt irgendein Infektionsrisiko darstellen soll? Können Sie mir irgendwelche Sachargumente nennen, inwiefern das Golfspielen im Vergleich zu anderen, erlaubten Freiluftaktivitäten wie Spazierengehen oder Joggen im Park ein höheres Risiko darstellen soll und infolgedessen weiterhin untersagt werden müsste?

Der DGV als Dachverband hat versucht, Entscheidungsträger wie Sie darüber zu informieren, wie Golf als Freizeitaktivität ausgeübt wird. (Sie sollten das übrigens auch mal probieren, das wird Ihnen gut tun… 🙂 ) Ich wiederhole dies der Vollständigkeit halber auch noch einmal am Beispiel meiner eigenen – jetzt ja leider durch Sie unterbundenen – Aktivität:

Ich fahre zum Golfplatz, in meinem Fall mit dem Fahrrad, weil ich in unmittelbarer Nähe wohne. (Die meisten Golfspieler in Deutschland dürften ihre Plätze mit dem Auto aufsuchen, eine Anfahrt mit öffentlichen Verkehrsmitteln, bei der es ein Infektionsrisiko geben könnte, ist vermutlich eine absolute Ausnahme.) Dann gehe ich zum Abschlag der ersten Bahn, spiele meinen ersten Ball – und laufe danach mutterseelenallein die neun oder 18 Löcher über den Platz. Zwei bis vier Stunden.

Niemand ist in meiner Nähe – wir reden hier nicht von 1,5 Metern, sondern von hunderten Metern. Abstand halten gehört aus Sicherheitsgründen elementar zum Golfspielen dazu – damit man nicht von fremden Bällen getroffen wird und andere nicht mit dem eigenen Ball trifft. In diesem Szenario – dem Einzelspiel oder „Einer-Flight“ ist eine Infektion oder irgendein Infektionsrisiko absolut ausgeschlossen.

Embed from Getty Images

Dass einem Spieler Hunderte oder Tausende Zuschauer folgen, ist die absolute Ausnahme – keine Sorge, Herr Laschet!

Kommen wir zu denkbaren anderen Szenarien. Auch beim Zusammenspiel von mehreren Personen ist es absolut üblich und überhaupt kein Problem, einen Abstand zu wahren – auch schon normalerweise meist ein Vielfaches mehr als 1,5 Meter. Nach den mittlerweile üblichen Spielbedingungen („Ready Golf“) geht jeder Spieler zu seinem Ball und spielt den bei Gelegenheit; immer unter der Maßgabe, keinen Mitspieler zu gefährden und also Abstand zu halten. Auch am Ziel einer jeden Bahn, dem „Grün“, wo der Ball (hoffentlich…) eingelocht wird, gibt es keinerlei Notwendigkeit oder Anlass, einen gewissen Abstand zu unterschreiten.

Selbstverständlich bedeutet auch das gemeinsame Spiel von Ehepartnern oder Angehörigen einer Haushaltsgemeinschaft keinerlei zusätzliches Risiko – selbstverständlich sind daher ja auch gemeinsame Spaziergänge erlaubt.

Mit der am Mittwoch eingeleiteten „Lockerung“ der Corona-bedingten Einschränkungen gehen wir aus der Phase der – übrigens ja von keinerlei gesicherten Fakten untermauerten – Erstreaktion in eine Phase der rationalen, abwägenden Gegenüberstellung: Was können Restriktionen bewirken, was sind die „Kollateralschäden“ dieser Restriktionen? Sind möglicherweise die Kollateralschäden größer als der mögliche Nutzen der Maßnahmen? Werden möglicherweise Grundrechte eingeschränkt, ohne dass dies in einer Abwägung der Verhältnismäßigkeit geboten und auch rechtlich zulässig ist?

Ich möchte Ihnen einmal – ganz subjektiv – die Auswirkungen schildern, die das Verbot des Golfspielens momentan für mich persönlich bedeutet: Golf ist für mich der – leider viel zu spät entdeckte – ideale Ausgleich für meine Tätigkeit als „Bildschirmarbeiter“. Ich bin 55 Jahre alt, habe einen schönen, aber auch stressigen Job als freiberuflicher Journalist beim Deutschlandfunk. Mit Frühdiensten, bei denen ich um 4 oder 5 Uhr aufstehen muss. Bei aller Routine – wann immer es Probleme oder Stress oder auch einmal Arbeitsplatzsorgen gibt, spüre ich mein Herz. Seit ich vor knapp drei Jahren mit dem Golfspielen angefangen habe, habe ich acht Kilo abgenommen, bin ausgeglichener, zufriedener, glücklicher.

Sie nehmen mir das gerade weg.

Aus Gründen, die nicht nachvollziehbar sind. (Ich warte natürlich gern auf Ihre diesbezüglichen „Sachargumente“…) Ich habe seit dem Beginn der Platzsperren vier Kilogramm zugenommen. Natürlich – ich könnte auch zwei Stunden täglich irgendwie so in vergleichbar schnellem Tempo mit einem Ersatzgewicht von 10 kg auf dem Rücken durch die Gegend latschen – in einer vermutlich im Vergleich zu einem Golfplatz signifikant höher „virenbelasteten“ Umgebung. Aber das ist natürlich utopisch. Ich trinke auch gerade mehr Alkohol als sonst. Auch das könnte ich natürlich lassen. Aber Sie selbst werden als Privatpersonen und ganz normale Menschen wissen – das theoretische „könnte man machen“ und das tatsächliche Machen sind zwei unterschiedliche Dinge.

Langer Rede kurzer Sinn: Die Restriktionen in Bezug auf Golfplätze treffen mich hart. Sie treffen mich hart in gesundheitlich, in physischer und psychischer Hinsicht. Sie treffen andere, ältere Golffreunde noch viel härter – möglicherweise sogar letztlich lebensgefährlich. Und es gibt meines Erachtens keine, aber auch gar keine dem entgegenstehende Sachargumente (auf etwaige Einlassungen Ihrerseits bin ich wie gesagt gespannt…).

Es gibt möglicherweise irgendwelche „Solidaritäts-Erwägungen“ nach dem Motto „wenn bestimmte Sporteinrichtungen schließen müssen, dann müssen alle schließen“. Aber mit Verlaub – das ist doch totaler Unsinn. Einem Handballer, der vielleicht aufgrund der Infektionsgefahr bei seinem doch recht kontaktträchtigen Sport in der Halle bis auf weiteres auf Training und Wettkämpfe verzichten muss, hilft es überhaupt nichts, wenn ich auch nicht – mutterseelenallein – Golfspielen darf. Auch bei den übrigen „Lockerungsmaßnahmen“ wird ja differenziert – wo gibt es hohe Risiken, wo geringe?

Ich möchte Sie – Sehr geehrter Herr Ministerpräsident, Sehr geehrte Frau Staatssekretärin – einmal bitten, über diese Dinge kurz und gründlich nachzudenken. Es geht hier nicht um die Freizeitbeschäftigung einer möglicherweise etwas elitären Bevölkerungsgruppe oder eine „Extrawurst“. Sondern es geht darum, abzuwägen: Was ist in dieser schwierigen Situation und angesichts erheblicher Einschränkungen und Einschnitte in das Leben aller Bürgerinnen und Bürger sachorientiert, rational und juristisch haltbar?

Mit freundlichen Grüßen,

Michael Gessat; Journalist, Köln

P.S. 18.04.2020 Das hier: („Jogging, Gymnastik und Golfen ja – Mannschaftssport nein“) bei meinem Sender lese ich aber jetzt mit großem Interesse 🙂 …

P.S. 03.05.2020 Mein Hoffen vom 18.04.2020 war ja offenbar auch nur ein großer Rohrkrepierer. Herr Laschet registriert zwar richtigerweise die „wachsende Wut“ in der Bevölkerung – aber offenbar nicht primär die von Golffreunden. Und offenbar ist seine BILD-Zeitungs-Angst immer noch größer als seine angebliche Neigung zur sachgemäßen Differenzierung und Wahrnehmung von Unverhältnismäßigkeiten. Frau Milz ist trotz ihrer angeblichen Empfindlichkeit für „herzerweichende“ Zuschriften von lahmgelegten Breitensport-Treibenden in einer bräsigen „Ich-kann-mir-doch nicht-alle-Sportarten-einzeln-angucken-Versenkung“ abgetaucht.

Auch der Golfverband NRW vermeldet Betrübliches:

Informationen zur Corona-Entwicklung und die Folgen für den Golfsport in NRW – Stand 02.05.2020 um 17:00 Uhr

Liebe Mitglieder,

am 30. April haben Bundesregierung und Ministerpräsidenten sich nicht mit dem Thema Lockerung der Verbote für den Breiten- und Freizeitsport befasst. Die von uns allen erhoffte Öffnung der Golfanlagen blieb aus. Das Thema wurde auf den 6. Mai vertagt. Wir als Golfverband NRW sind enttäuscht.

Trotz der intensiven Lobbyarbeit des DGV auf Bundesebene und des Golfverbandes auf Landesebene müssen wir leider feststellen, dass Lockerungen des Amateur- und Breitensports im allgemeinen sowie die Freiluftsportarten im Besonderen von der Politik im Bund und in NRW zurückgestellt werden.

Unsere Geschäftsstelle haben seitdem zahlreiche emails erreicht, in denen wir zur Einleitung eines gerichtlichen Verfahrens aufgefordert werden. Dazu ist folgendes klarzustellen:

Das Präsidium hat sich in den letzten Wochen mehrfach mit der Frage befasst, ob und welche rechtlichen Möglichkeiten für uns als Verband bestehen, gegen die Schließung der Golfanlagen vorzugehen. Nach Auffassung des Präsidiums hätte ein durch den Golfverband NRW angestrengtes gerichtliches Verfahren schon deswegen keine hinreichende Aussicht auf Erfolg, da der Golfverband NRW nicht Betreiber einer Golfanlage und damit nicht unmittelbar von dem Verbot Betroffener ist. Die bloß mittelbare Betroffenheit über unsere Mitglieder und Aktiven reicht nicht aus.

Soweit wir auf ein von dem Bayerischen Golfverband angestrengtes Verfahren hingewiesen werden, ist nach unseren Informationen, der Bayerische Golfverband nicht Antragssteller dieses Verfahrens, sondern vielmehr eine Betreibergesellschaft, die das Verfahren im eigenen Namen und auf eigene Kosten führt.

Nach unserer Kenntnis ist vor den zuständigen Gerichten in NRW bereits ein von verschiedenen Personen angestrengtes sog. Eilverfahren anhängig. Ein weiteres Verfahren wird nach unseren Informationen aktuell vorbereitet. Wir hoffen auf eine zeitnahe Klärung der offenen Rechtsfragen durch die Gerichte. Der Golfverband NRW ist grundsätzlich bereit, derartige Verfahren, soweit sie im Interesse unserer Mitglieder liegen, angemessen zu unterstützen.

Bei aller nachvollziehbaren Enttäuschung und Frustration über die Schließungen der Golfanlagen und die Entscheidungen der Politik, auf die wir als Golfverband leider keinen Einfluss haben, möchten wir Sie darum bitten, die Grundregeln des menschlichen Anstands und des Umgangs, insbesondere gegenüber den Mitarbeiterinnen und Mitarbeitern unserer Geschäftsstelle zu wahren. Das war in der Vergangenheit leider nicht immer der Fall. Vielen Dank.

Bleiben Sie gesund!

Das Präsidium

Ok, da bleiben für mich in dem zitierten Text jetzt so ein paar Fragen offen: „Trotz der intensiven Lobbyarbeit des DGV auf Bundesebene und des Golfverbandes auf Landesebene“ und „die Entscheidungen der Politik, auf die wir als Golfverband leider keinen Einfluss haben“… Ach so, ich dachte „Lobbyarbeit“ hieße eben genau Einfluss auf Entscheidungen der Politik nehmen, oder das zumindest versuchen. Das war wohl nix. Da kann man natürlich schon ganz kurz drüber nachdenken, ob dann die bislang handelnden Personen den bestmöglichen Impact-Faktor haben oder auch nicht. Oder ob da niemand eine Chance gehabt hätte; aufgrund der Bräsigkeit und der BILD-Zeitungs-Empfindlichkeit („bitte nicht den Fahrstuhl runter…“) der Kanzlerkandidaten.

Geschenkt. Jetzt kommt tatsächlich langsam die Stunde der Gerichte. Man kann ja zur Auffassung von Epidemiologen stehen, wie man will – auf den Golfplätzen wird sich die Schlacht jedenfalls nicht entscheiden. Da sind eindeutig die Kollateralschäden um Dimensionen höher als der vermeintliche Nutzen der Einschränkungen.

Ich nehme das mal mit Interesse zur Kenntnis, was in dem GVNRW-Statement an laufenden Verfahren berichtet wird. Völlig klar – eine erfolgreiche Klage muss unter Darlegung der persönlichen Betroffenheit erfolgen. Anregungen dazu in meinem Post – ab nächster Woche werde ich selbst auch Klage einreichen.

Mit etwaigen Wahlstimmen für Sie, lieber Herr Laschet, liebe Frau Milz – das wird jetzt irgendwie nix mehr. Trotzdem sollten Sie es mal versuchen mit dem Golfspielen. Wird Ihnen guttun. Auch sogar in Hinblick auf: Richtige Entscheidungen treffen.

P.S. 07.05.2020: Ich habe gerade überraschenderweise eine Antwort auf meinen Brief/meine Mail vom 16.04.2020 an Herrn Laschet und Frau Milz bekommen. Es lebe der bürgernahe Dialog! Da die Staatssekretärin jetzt nicht allzu differenziert auf meine Fragen bzw. Argumente eingeht 🙂 , ist es glaube ich ok, wenn ich dieses Schreiben hier ohne vorherige Nachfrage bei der Staatskanzlei auch veröffentliche:

Dass wir uns jetzt netterweise „nun wieder bewegen“ und unsere „geistige Gesundheit und Mobilität stärken“ dürfen, hatte ich allerdings auch schon durch intensive Beobachtung der Nachrichtenlage mitbekommen. 🙂 Morgen um 14 Uhr habe ich meine erste Startzeit. Das wird eine langwierige Rekonvaleszenz, fürchte ich.